OpenAI, geçtiğimiz hafta perşembe günü kamuoyuna tanıttığı video yaratım modeli Sora’yla suni zekâ dünyasını bir kez daha altüst etti.

Toplumsal medyada paylaşılan örnekler, Sora’nın kolay metin komutları üstünden fazlaca detaylı ve karmaşa videolar ürettiğini gösteriyor. Mesela “Tokyo’nun dış mahallelerinden geçen bir trenin camındaki yansımalar” komutuyla üretilen video, titreyen kamera ve cama yansıyan yolcu detaylarıyla tam anlamıyla telefon kamerasıyla çekilmiş bir video gibiydi. Üstelik videodaki insanların ellerinde de hiçbir tuhaflık yoktu.

“Kırmızı yünden örülmüş motosiklet kaskı diyen 30 yaşındaki bir insanın maceralarını özetleyen bir filmin fragmanı, mavi sema, tuz çölü, sinematik biçim, 35 mm filmle çekilmiş, canlı renkler” komutuyla hazırlanan video da Christopher Nolan ile Wes Anderson’ın filmlerinin karışımı benzer biçimde bir havaya sahipti.

Golden retriever yavrularını karda oynarken gösteren videoda köpeklerin tüyleri o denli yumuşak, kabarık kar da o denli gerçekçiydi ki insanda “Ekrana elimi uzatsam dokunabilirim” hissi oluşuyordu.

Bu aşamada sorulması ihtiyaç duyulan 7 trilyon dolarlık sual şu: OpenAI bunu iyi mi başardı? Bu probleminin yanıtını bilmiyoruz bundan dolayı OpenAI, Sora’nın eğitim verilerine dair neredeyse hiçbir izahat yapmadı. Sadece bu kadar gelişmiş bir modeli eğitmek için Sora’nın fazlaca büyük oranda video verisine gereksinim duyduğu kati. Bu da bizlere interneti köşe nahiye tarayıp mevcud video içeriklerini kullandıklarını düşündürüyor. Doğal bu da eğitim verilerinde telifli içeriklerin de kullanıldığı iddialarına yol açtı. OpenAı, Sora’nın eğitim verileriyle ilgili yorum taleplerine cevap vermedi.

OpenAI’ın teknik belgesi ağırlıklı olarak bu neticeleri elde etmek için kullanılan metoda odaklanıyor. Sora görsel veriyi “yamalara” kısaca modelin anlayabileceği veri parçalarına çeviren bir diffüzyon modeli. Sadece görsel verinin nereden geldiğinden belgede bahsedilmiyor.

OpenAI, Sora’nın “web üstündeki verilerle eğitilerek genel olarak işe yarayabilecek beceriler edinen büyük dil modellerinden esin aldığını” belirtiyor. Belgede eğitim verisinin kaynağına dair tek referans bu fazlasıyla muğlak “esin alma” ifadesi.

Belgenin devamında OpenAI, “metinden video üretme sistemlerinin eğitimi, metinlere uygun fazlaca büyük oranda video gerektirmektedir” diyor. Bu kadar büyük oranda görsel veri bir tek internette bulunabilir. Bu da Sora’yla ilgili bir öteki ipucu.

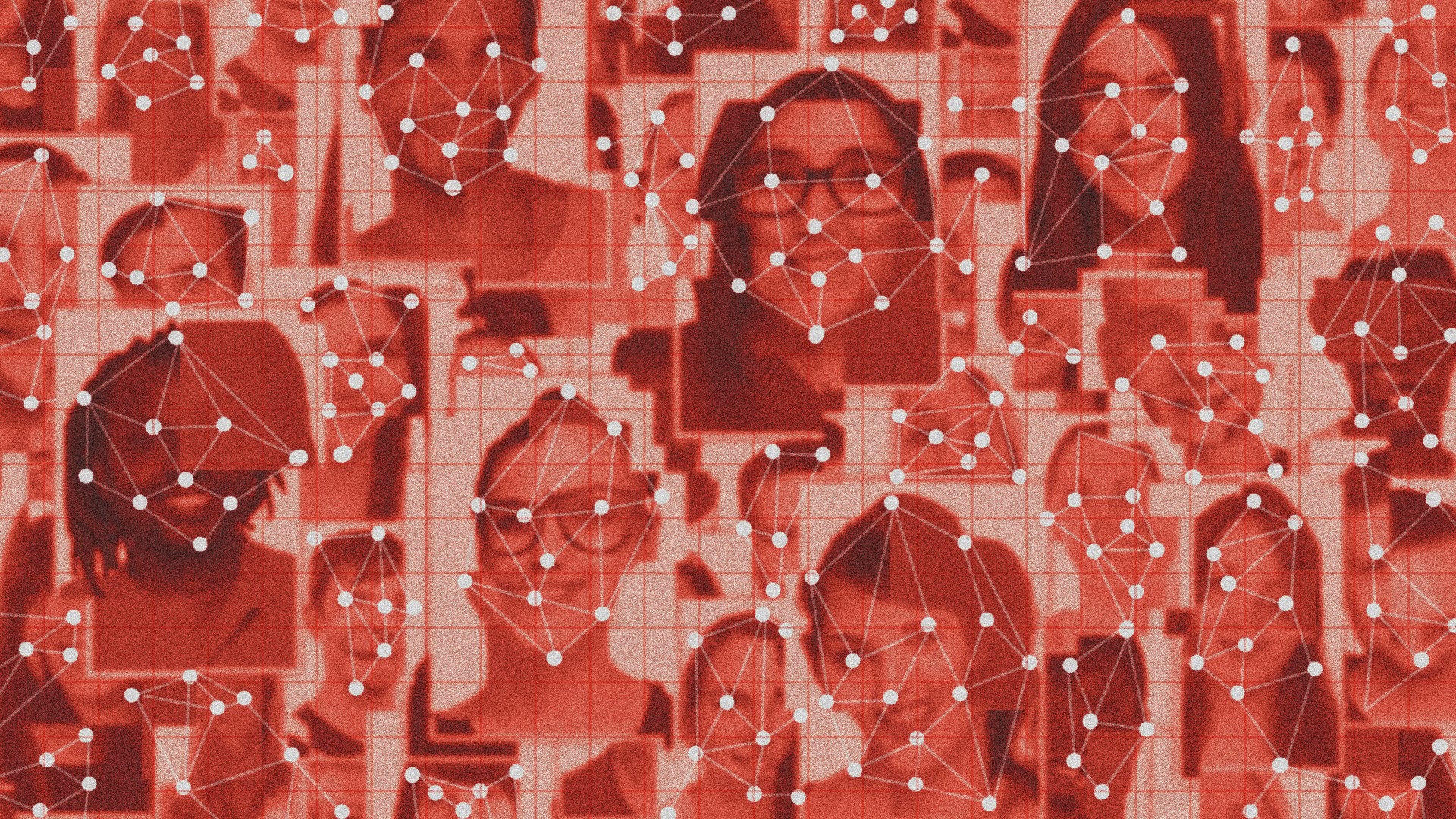

Eğitim verilerinin suni zekâ modelleri tarafınca kullanımıyla ilgili hukuki ve etik meseleler, OpenAI’ın ChatGPT’yi kullanıcıya sunmuş olduğu günden beri tartışılıyor. Hem OpenAI hem de Google, dil modellerini eğitmek için veri “çalmakla” suçlandı. Teknoloji devleri, toplumsal medya, Reddit ve Quora benzer biçimde çevrimiçi forumlar, Wikipedi, hususi kitapların veri tabanları ve haber sitelerdeki verileri kazıyıp kullanmakla itham ediliyor.

Kısa süre öncesine kadar, webin tamamının eğitim verisi olarak kazınması tartışmasında kriter, kamuoyunun o içeriğe erişebilir olup olmadığıydı. Sadece kamuoyunun erişebilir olması daima her insana açık anlamına gelmiyor. Mesela The New York Times geçtiğimiz günlerde OpenAI’a ve Microsoft’a dava açtığını duyurdu. Gazete, OpenAI’ın modellerinin kendi haberlerini kelimesi kelimesine kullandığını ya da haberlere doğru olmayan referanslar verdiğini iddia ediyor.

Görünüşe bakılırsa, OpenAI aynı şeyi şimdi de videolarla yapıyor. Bir başka deyişle gelecek günlerde eğlence sektörünün ağır toplarından bu mevzuda bir şeyler duyabiliriz.

Sadece bu durum karşı karşıya olduğumuz problemi ortadan kaldırmıyor: Biz hâlâ Sora’nın eğitim verisinin kaynağını bilmiyoruz. ABD Senatosunun Suni Zeka Denetim Komitesi’nde ifade veren YZ uzmanı Gray Marcus, Substack’te piyasaya çıkan yazısında, “Şirket (adının aksine) modellerini hangi verilerle eğittiği mevzusunda hep ketum oldu” ifadelerini kullandı ve ekledi:

“Birçok şahıs Unreal benzer biçimde oyun motorlarından üretilmiş fazlaca fazla araç-gereç olduğu yönünde spekülasyonda bulunmuş oldu. Ben YouTube kaynaklı ve telifli pek fazlaca eğitim içinde ne olduğu olmasına da şaşırmam doğrusu. Burada büyük olasılıkla sanatçılar ayvayı yiyor.”

OpenAI’ın gizemini açıklamayı reddetmesine rağmen, sanatçılar ve yaratıcılar en fena olasılık üstünde duruyor. Mesela film yapımcısı ve SAG-AFTRA yaratıcı suni zekâ danışmanı Justine Bateman, X paylaşımında sözünü sakınmadı ve “Bu #YZ çöpünün her nanosaniyesi, gerçek sanatçılardan çalınmış işlerle eğitiliyor. İğrenç” ifadelerini kullandı.

Yaratıcı sektörlerde çalışıp, Sora ve benzeri video üretim modellerinin yükselişinin işlerini iyi mi etkileyeceğine dair kaygı duyanlar da var. Mesela @jimmylanceworth, “Ben filmler için görsel effekt üretiyorum. Tanıdığım hepimiz öldük bittik modunda, ‘Şimdi ne yapacağız’ diye ürkü halinde” paylaşımını yapmış oldu.

OpenAI Sora’nın yaratacağı korkulu tesirleri tamamen gözardı etmiş değil. Sadece şirket ağırlıklı olarak deepfake’lere ve yanlış bilginin ihtimaller içinde zararlarına odaklanıyor. Sora şu an kırmızı ekip fazında kısaca uygunsuz ve zararı dokunan içerikle ilgili stres testleri yapılıyor.

Duyurunun sonlarına doğru OpenAI, “kaygılarını idrak etmek ve bu yeni değişen teknolojinin pozitif yönde kullanım alanlarını belirlemek için dünyanın dört bir tarafındaki siyaset yapıcıları, eğitimcileri, sanatçıları sürece dahil ettiğini” de altını çizdi.

Sadece bu sözler, Sora’nın varlığının çoktan yaratmış olduğu zararları karşılamıyor.

Mashable Teknoloji Muhabiri Cecily Mauran’ın haberini Sevin Turan Türkçeleştirdi.