Acil yetiştirmeniz ihtiyaç duyulan sunum için bir balon görseline ihtiyacınız bulunduğunu düşünün. Derhal metinden görsel üreten YZ aracından yardım arardınız değil mi? Midjourney ya da DALL-E benzer biçimde. Sonrasında bu araçta “mavi gökyüzünde uçan kırmızı bir balon” cümlesini yazdığınızı sadece aracın bir yumurta görseli ürettiğini düşünün. Yine deniyorsunuz sadece bu kez de karpuz görseli çıkıyor karşınıza.

Ne oluyor?

Kullandığınız YZ aracı “zehirlenmiş” olabilir!

Veri zehirlenmesi nedir?

Metinden görsel üreten araçlar milyonlar ya da milyarlarca görsel içeren devasa veri kümeleriyle eğitiliyor. Adobe ya da Getty’nin üretici araçları benzer biçimde olanlar, üreticinin kendi görselleri ya da lisanslı görsellerle eğitiliyor.

Sadece öteki üretici araçlar “ellerine geçen” tüm online görsellerle eğitiliyor, ki bu da fikri iyelik haklarının ihlallerini de doğuruyor. Sanatçılar bu yüzden büyük teknoloji firmalarını, kendi işlerini çalmak ve bunlardan kâr elde etmek suçlamasıyla mahkemeye verdi.

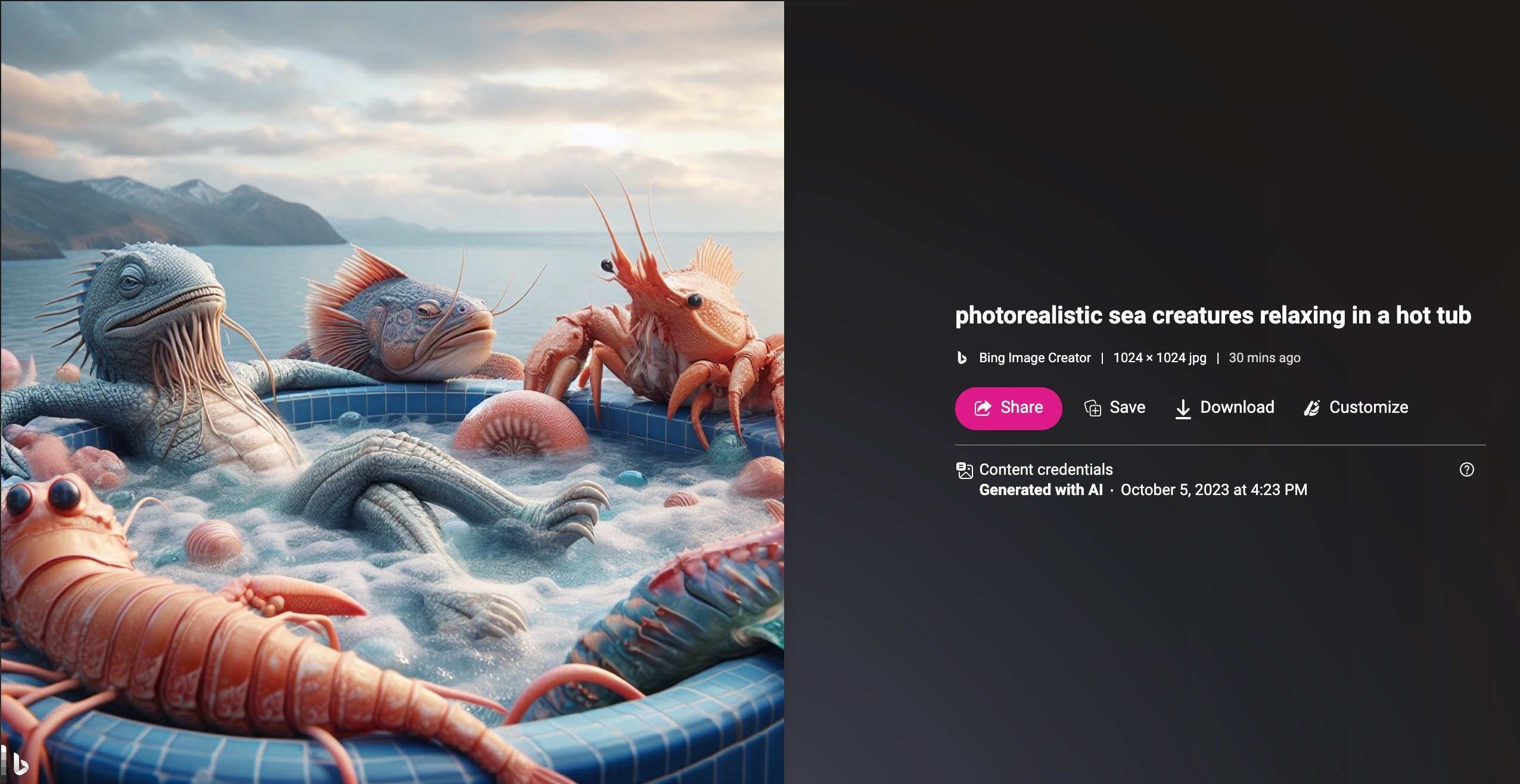

“Zehir” fikri de tam bu aşamada ortaya çıkıyor. Bağımsız sanatçıları güçlendirmek isteyen araştırmacılar, yakın geçmişte “Nightshade” isminde bir vasıta yarattı ve bu vasıta izinsiz görsel veri toplanmasına karşı savaşım veriyor.

Vasıta, görselin piksellerini “bilgisayar görüşü” için okunamaz hâle getirirken, insan gözleri için bir mesele yaratmıyor.

Eğer bir şirket gelecek YZ modeli için bu görselleri tararsa, veri havuzu zehirlenmiş oluyor. Bu da algoritmanın görselleri “insanların bildiğinden” değişik öğrenebilmesine yol açıyor. Bunun sonucunda da, üretilen görseller yanlış, hatalı ya da beklenmedik şekilde çıkıyor.

Zehirlenme emareleri

Daha ilkin verdiğimiz örneğe dönelim, balon, yumurtaya dönüşebilir. Monet stilinde çizilmesini istediğiniz görsel, Picasso stilinde çıkabilir. Daha erken dönem YZ’larda gördüğümüz kimi problemler, mesela elleri çizemeyen modeller benzer biçimde problemler geri dönebilir. Modeller ek olarak görsellere başka acayip ve mantıksız özellikler de ekleyebilir; altı ayaklı köpekler ya da bozulma olmuş masalar benzer biçimde.

YZ eğitiminde kullanılan görsellerdeki “zehirli” kısım arttıkça, bozulma da artıyor. Üretici YZ’nın emek verme şeklinden dolayı, “zehirli” görsellerin yarattığı zarar, komut anahtar kelimelerini de bozuyor.

Bunu birazcık daha açalım; mesela “zehirli” bir Ferrari görseli, eğitim verisinde kullanıldıysa, değişik otomobil markaları ya da vasıta ve otomobil benzer biçimde ilgili anahtar kelimelere dair komut işlemleri de etkilenecektir.

Nightshade’in geliştiricisi aracın büyük teknoloji şirketlerinin fikri iyelik haklarına uymalarını sağlamasını umuyor, fakat doğal ki kullananların bu aracı kötüye kullanarak “zehirli” görselleri üreticilere yükleyip, hizmetlerini bozması da söz mevzusu.

Panzehri var mı?

Bu “zehre” karşı, hisse sahipleri teknolojik ve insan içeren çözümler üretiyor. En belirgin olanı, verinin nereden geldiği ve iyi mi kullanılacağına dikkat etmekten geçiyor. Bunu yapmak daha azca gelişigüzel veri toplamayla sonuçlanıyor.

Bu yaklaşım, bilgisayar bilimcileri içinde sık görülen bir inanca da ters düşecektir: Çevrimiçi bulunan veri, istenilen her şekilde kullanılabilir.

Bulunan değişik bir çözüm de “toplu modelleme”. Bu yaklaşımda modellerin birçok değişik veri alt kümesi üstüne eğitilip, belirli aykırı değerleri bulmak için karşılaştırıldığı modellemede, şüpheli doğrusu “zehirli” görüntüleri tespit edip, küme haricinde bırakmak da mümkün olabilir.

Denetleme yolu da bulunan başka bir çözüm. Bir denetleme yaklaşımı, minik sadece doğru şekilde düzenlenmiş ve adlandırılmış kontrol bataryası kullanarak, eğitim için kullanılamayacak verileri “dışlamayı” içeriyor. Bu veri seti hemen sonra da modelin doğruluğunu ölçmek için kullanılabilir.

Teknolojiye karşı stratejiler

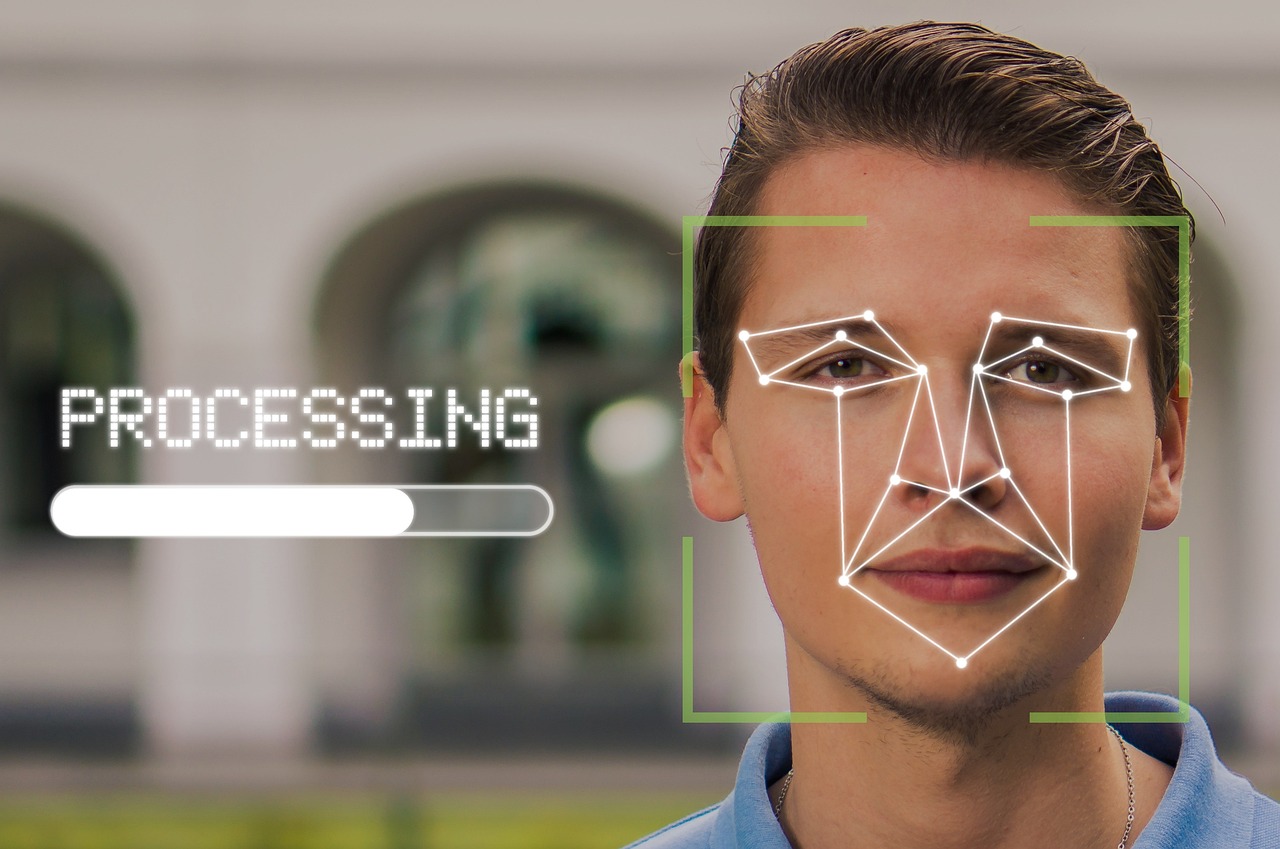

Veri zehirlemesi dahil, YZ sistemlerini aldatmaya, bozmaya, kirletmeye ya da manipüle etmeye yönelik bu yaklaşımlar yeni bir şey değil. Makyaj ve kostümler kullanarak yüz tanıma sistemlerini yanıltma benzer biçimde işlemlerde de bu yaklaşım kullanılabiliyor.

İnsan hakları aktivistleri bir süredir makine görüşünün, toplumlarda daha geniş şekilde, fark gözetmeksizin kullanılmasından kaygı duyuyor. Bu kaygı bilhassa yüz tanıma sistemleri mevzusunda oldukça ciddi.

Clearview AI benzer biçimde, web üstünde satılan ve “aranabilir yüzlerden” oluşan devasa veritabanları dünya genelinde devlet kurumları ve kolluk kuvvetleri tarafınca kullanılıyor. Avustralya hükümeti 2021 senesinde Clearview AI’ın, vatandaşlarının gizliliğini ihlal ettiğine karar vermişti.

Meşru protestolardaki protestocular benzer biçimde kişilerin profillerinin belirlenmesi amacıyla kullanılan yüz tanıma sistemlerine cevap olarak sanatçılar, gözetleme sistemlerini onları tanımasını engellemiş olan asimetrik eğriler ve tırtıklı çizgilerden oluşan makyajlar tasarladı.

Her ikisi de teknoloji yönetimi etrafındaki daha büyük sorularla ilgili olduğundan, bu vakalarla, veri zehirlemesi içinde açık bir bağlantı bulunuyor.

Teknoloji şirketlerinin bir çok, veri zehirlenmesini teknolojik çözümlerle çözülmesi ihtiyaç duyulan sinir bozucu bir sorun olarak görüyor. Sadece veri zehirlenmesini, sanatçı ve kullananların temel haklarına yönelik müdahaleye karşı yenilikçi bir çözüm olarak görmek daha doğru olabilir.

The Conversation’ın haberini Erinç Eröz Türkçeleştirdi